In einem AI & LLM Application Penetration Test wird eine KI und LLM basierte Applikation auf vorhandene Sicherheitslücken und fehlende Härtungsmassnahmen geprüft. Im Fokus stehen Risiken, die durch natürliche Sprache als Eingabe, Retrieval wie zum Beispiel RAG, System Prompts, Meta Prompts sowie Tool und API Integrationen entstehen. Diese Angriffsflächen werden mit klassischen Web oder API Penetration Tests oft nur teilweise abgedeckt.

Als Referenzrahmen verwenden wir die OWASP Top 10 for Large Language Model Applications. Diese bietet eine strukturierte Übersicht der wichtigsten Risikoklassen für LLM Anwendungen.

Zusätzlich nutzen wir den OWASP Large Language Model Security Verification Standard, kurz LLMSVS, als Standard für Sicherheitsanforderungen an LLM gestützte Applikationen.

Ergänzend ziehen wir MITRE ATLAS als Knowledge Base heran, um Angreifer Taktiken und Techniken gegen AI und ML Systeme in praxisnahe Testszenarien zu überführen.

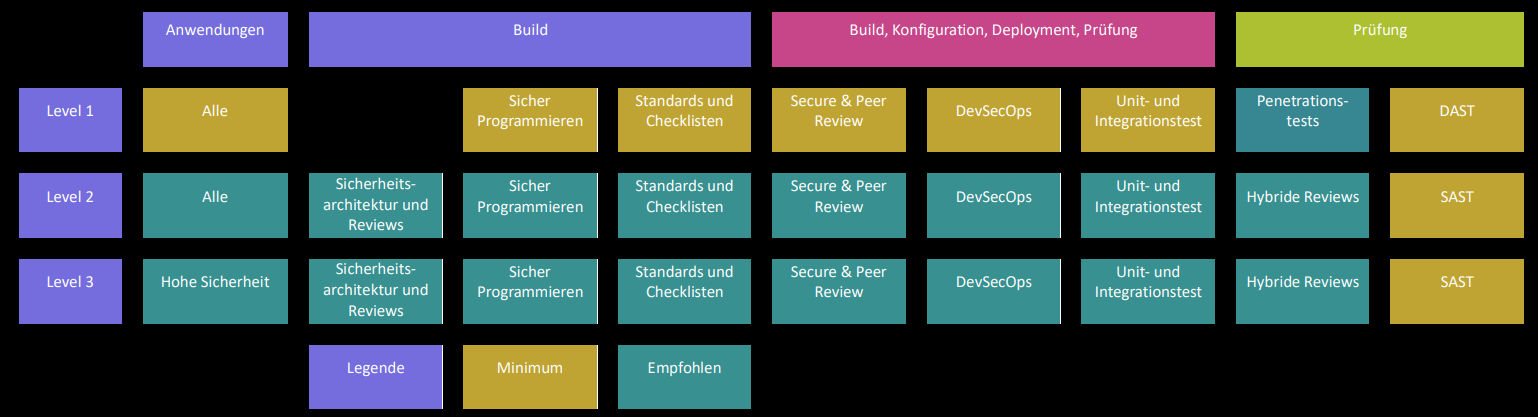

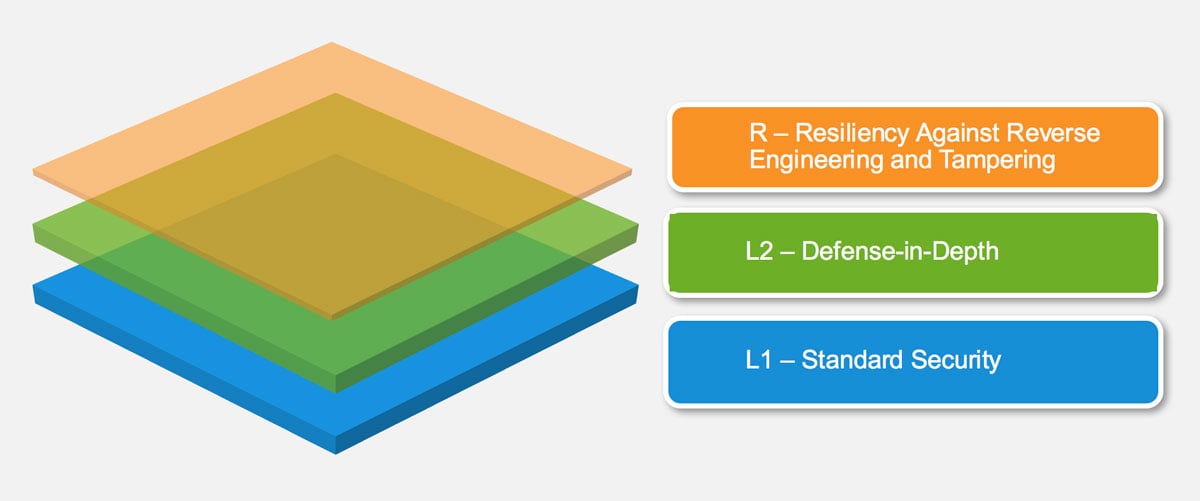

Der LLMSVS ist ein OWASP Projekt mit dem Ziel, einen offenen Sicherheitsstandard für Systeme zu schaffen, die künstliche Intelligenz und Large Language Models einsetzen. Er bietet eine Basis für das Design, den Bau und das Testen robuster LLM Applikationen und adressiert unter anderem Architektur, Model Lifecycle, Training, Betrieb und Integration, Storage sowie Monitoring.

Die Anforderungen des LLMSVS wurden mit den folgenden Zielsetzungen entwickelt:

- Verwendung als Massstab. Bereitstellung eines Sicherheitsstandards, mit dem LLM Applikationen beurteilt und vergleichbar gemacht werden können.

- Verwendung als Leitfaden. Bereitstellung von Leitlinien für Entwurf, Entwicklung und Betrieb sicherer LLM Applikationen.

- Unterstützung für Audits und Penetration Tests. Hilfestellung für Security Teams bei Reviews, Audits und Penetration Tests von LLM gestützten Systemen.

- Etablierung und Weiterentwicklung von Benchmarks. Förderung von Best Practices und eine gemeinsame Erwartungshaltung zwischen Stakeholdern wie Entwicklung, Security, Vendoren und Kunden.

Der genaue Umfang wird je nach Kunde und Applikation im Scoping festgelegt. Dazu gehören zum Beispiel die Chat oder Assistenz Funktion, RAG Datenquellen, Rollen und Berechtigungen, Guardrails, Tool und API Zugriffe, gewünschte Testtiefe sowie Testszenarien.

Weitere Informationen zum Ablauf eines Penetration Tests.